VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

VS

索尼于5月27日正式启动年度游玩日促销活动,持续至6月10日。本次最大亮点在于PSVR2在去年永久降价($549→$399)基础上再折$100,使得《HorizonCalloftheMountain》捆绑...

Meta在HorizonOS2.4的公测版中,悄悄补上让VR体验更接近"科幻电影"的细节。对于习惯了手势追踪的用户而言,这次更新最大的意义在于"去手柄化"的进一步实现,你可以完全...

Meta正在加速将Quest3从单一的"游戏机"向通用的"空间计算机"转型。在最新的HorizonOS公测版(PTC)中,一项名为"浏览器图片3D化"的功能悄然上线,配合系统级快捷控制的优...

虚拟现实平台再添重磅娱乐应用。DIRECTV近日正式在MetaQuest头显上推出其官方应用,为用户提供一个沉浸式的"家庭影院"体验,无需额外订阅即可观看大量免费内容。150+...

自2026年4月20日(本周日)起,Meta将上调其Quest3系列VR头显的官方售价。此次调价幅度为:Quest3S(128GB):从300美元上调至350美元(+50美元)Quest3S(256GB):从400美元上调至450美...

模拟 | 教育 | 工具

模拟 | 教育 | 探索

休闲 | 模拟 | 益智

益智 | 解谜

益智 | 休闲 | 射击

冒险 | 解谜 | 剧情

RPG | 冒险 | 模拟

冒险 | 解谜 | 休闲 | 益智 | 策略

上一次在XR头显上看到"宏碁"标识,还要追溯到2019年发布的OJO500--一款主要面向企业市场的WindowsPCVR设备。此后,宏碁在XR领域几乎销声匿迹,将更多资源投入到SpatialLabs品牌下的裸眼3D显示器、笔记本电脑及相机等产品。如今,这家来自中国台湾的科技巨头重新入场,一口气推出两款新品:有线AR眼镜ARVisionGR0,以及类似Meta风格的AI智能眼镜GI0。有线AR眼镜:ARVisionGR0ARVisionGR0通过线缆连接iOS与Android智能手机,以及WindowsPC,配备两块1920×1080分辨率的Micro-OLED显示屏,光学方案采用与XREAL、VITURE等厂商类似的"鸟浴式"设计。虽然宏碁并未公布具体的视场角参数,但官方宣称可在6米距离模拟出172英寸巨幕体验。其目标场景覆盖游戏娱乐、生产力工具,以及在公共空间中的工作隐私保护。该机型将在北美率先发售,起售价约500美元;欧洲、中东及非洲地区(EMEA)预计于2026年第四季度上市,定价600欧元;澳大利亚则会在2026年第三季度开售,售价1000澳元。名称宏碁ARVisionGR0型号GR100F操作系统兼容性安卓、iOS、Windows显示屏双微型OLED屏幕,亮度200尼特,单眼分辨率1920x1080,刷新率60Hz,DCI-P3 95%色域,24位色彩,对比度50000:1音频立体声,每侧一个动圈单元电源充电5.5伏0.85安连接方式有线控制滑动调节亮度,滑动调节音量尺寸和重量瞳距:64毫米,69克传感器3自由度传感器、加速度计、接近传感器、磁力计特征可拆卸遮光罩,可选配近视磁吸镜片AI智能眼镜:GI0AIGlassesGI0AIGlasses是否搭载AndroidXR平台尚不明朗,但宏碁确认其AI功能依赖GoogleGemini,可实现语音交互、实时图像识别与翻译。硬件方面,这款眼镜内置1200万像素摄像头,支持3024×4032静态照片拍摄,以及1920×1080分辨率、30fps的视频录制--影像规格略低于Ray-BanMeta第二代。使用GI0AIGlasses需要与Android或iOS设备配对,并通过蓝牙5.0与Wi-Fi5连接,同时依赖AcerAspireSync配套应用。价格策略上,北美市场起售价为300美元;EMEA地区将于2026年第四季度上市,售价400欧元;澳大利亚则在2026年第三季度上市,定价600澳元。名称宏碁GI0型号GI100人工智能模型谷歌Gemini操作系统兼容性安卓12及以上版本,iOS15及以上版本配套应用程序AcerAspireSync摄像头12M–图像:3024x4032;视频:1920x1080,30帧/秒音频立体声,每侧一个动圈单元,三个麦克风存储32GBeMMC电池217毫安时充电功率5伏1安连接方式支持Wi-Fi5和蓝牙5.0控制短按和长按的捕获按钮尺寸和重量46克(仅框架)功能GoogleGeminiAI语音助手、状态指示灯、侧边触控板、AI翻译、AI字幕

在今年的GoogleI/O大会上,XR眼镜厂商XREAL与谷歌联合展示了双方合作的重磅产物--ProjectAura。这款采用有线连接设计的轻量化AR眼镜,不仅是谷歌AndroidXR生态的硬件载体,更深度融合了GeminiAI能力,试图在苹果VisionPro的"空间计算"与Meta的"元宇宙"之外,开辟一条属于Android阵营的第三条道路。产品解析:70°视场角的"光学透视"ProjectAura并非一款消费级娱乐终端,而是定位为空间计算平台。其核心硬件规格包括:显示规格:采用OLED屏幕,拥有高达70°的视场角(FOV),这在轻量化眼镜形态中属于第一梯队水平,能有效减少"通过窗户看世界"的隧道效应。形态设计:坚持光学透视(OpticalSee-Through),区别于VisionPro的视频透视(VideoSee-Through),旨在提供更自然的环境融合感。计算核心:搭载高通骁龙处理器,运行原生AndroidXR系统。交互革命:Gemini驱动的"环境感知"Aura的最大变量在于软件与AI。依托谷歌的Gemini大模型,这款眼镜不再是被动的信息显示器,而是具备了情境感知能力。在I/O现场的演示中,Aura展现了三大核心场景:空间生产力:通过DisplayPort连接笔记本电脑,将传统的2D窗口转化为锚定在空间中的多模态3D界面,实现"随身巨幕"与"空间多屏"。沉浸式媒体:支持GoogleMaps的空间导航,以及YouTube的180°/360°全景视频播放,并能智能切换大小屏模式。AI原生交互:结合WebXR与Gemini,实现了3D绘画等创新应用。AI能够理解用户眼前的物理环境,并在不同应用间提供无缝的辅助服务。得益于AndroidXR的底层兼容性,Aura天然继承了GooglePlay生态,数百万个Android手机和平板应用无需重构即可在眼镜端运行,解决了XR设备长期面临的"内容荒"痛点。生态共建:开发者催化剂计划为了填补原生XR内容的空缺,XREAL与谷歌同步启动了"AndroidXR开发者催化剂计划"。该计划将于2026年夏季向首批入选开发者寄送Aura开发套件,并提供专属SDK与新API接口支持。这一举措明确释放了信号:ProjectAura的目标是在今年晚些时候的全球发布前,构建起一套区别于苹果VisionPro的差异化内容生态。

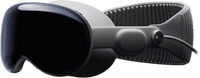

索尼于5月27日正式启动年度游玩日促销活动,持续至6月10日。本次最大亮点在于PSVR2在去年永久降价($549→$399)基础上再折$100,使得《HorizonCalloftheMountain》捆绑套装到手价仅$299.99,创上市以来官方渠道最低价。历史价格复盘:从首发溢价到亲民区间PSVR2自2023年首发定价$549.99以来经历多次调价,2024年黑五曾短暂触底$350(含游戏捆绑)。去年两周年纪念时索尼官宣永久降至$399.99MSRP,此番DaysofPlay限时再减$100,实际入手门槛较首发降低约45%,已逼近MetaQuest3主流价位段,对主机端高保真VR潜在用户形成较强刺激。促销明细与套装内容本次DaysofPlay明示折扣如下:PSVR2Horizon捆绑包:$399→$299PULSEExplore真无线耳塞:-$50PULSEElite无线耳罩耳机:-$40DualSenseEdge精英手柄:-$30Access无障碍控制器:-$30DualSense标准手柄:最高-$20$299捆绑包内含:PSVR2头显、一对PSVR2Sense控制器(含腕带)、USB-C充电线、三尺寸耳塞立体声耳机。PS5游戏方面,《对马岛之魂:夜刀传》《绝地潜兵2》《死亡搁浅2》《最后生还者2重制版》等亦有折扣,但索尼暂未确认VR原生大作(如《生化危机8VR》《GT7VR》)是否参促。PSVR2PC适配转接盒、备用Sense控制器及收纳包亦未在首轮明示清单中,建议持续关注官网更新。购买建议若持有PS5且有意体验OLEDHDR、眼动追踪及110°FOV的高画质VR内容,本轮$299是截至目前最理想窗口。注意此为限时促销,6月10日截止。

在三星GalaxyXR发售仅数月后,Google便火速推送了AndroidXR的首个重大系统更新。这次更新通过引入AI实时2D转3D、手部遮挡和窗口钉贴,谷歌正试图在混合现实的交互标准上与苹果VisionPro对齐,同时不忘切入企业级市场。AI驱动的空间化:无需片源,算力换体验本次更新的核心亮点在于"自动空间化"。该功能入口位于系统设置的"实验室"菜单中,一旦启用,系统会常驻一个机器学习模型,实时分析当前处于焦点的2D窗口内容。其工作原理是将普通的2D图像、视频、网页甚至游戏画面,即时合成为具有立体景深的3D画面(1080p/30fps)。这意味着开发者无需做任何适配,用户就能获得类似"裸眼3D"的观看体验。这不仅是AndroidXR独有的杀手锏,也是谷歌试图用AI算力弥补XR原生内容匮乏的战略举措。代价则是显著的能耗增加,系统会在过热或高负载时自动关闭该功能。视觉欺骗与空间锚点:追赶苹果的"临场感"为了提升虚拟物体的真实感,AndroidXR终于加入了手部遮挡。此前,XR设备在显示手部时多采用简单的轮廓线,导致手像幽灵一样漂浮在物体上。新版本通过2D图像分割模型,将真实的手"抠"出来覆盖在虚拟内容之上,虽然在暗光环境下表现仍不稳定,但在视觉逻辑上已追平VisionPro。此外,窗口钉贴功能上线。用户可以将应用窗口(如日历、Netflix)直接吸附在真实的物理墙壁上,甚至投射出比物理电视更大的虚拟屏幕。不过,谷歌在这方面的完成度略逊一筹:相比苹果和Meta支持的重启后位置保留,AndroidXR目前的钉贴仅限单次会话有效,重启即失效。企业级野心:从消费娱乐转向生产力除了面向消费者的功能,本次更新最务实的一步是全面支持AndroidEnterprise。谷歌联合了ArborXR、MicrosoftIntune、SamsungKnox等主流企业移动管理平台,为XR头显引入了零接触部署和静默安装应用的能力。这表明谷歌并不满足于将AndroidXR打造成游戏机,而是意图将其作为企业培训、远程协作的标准工具,解决企业批量采购XR设备时的管理和运维痛点。值得注意的是,这些功能不仅适用于三星GalaxyXR,也将同步落地到即将发布的XREALProjectAura等第三方设备上。随着底层芯片(骁龙XR2+Gen2)和操作系统的标准化,AndroidXR正在构建一个比Meta更开放的硬件联盟。

Meta在HorizonOS2.4的公测版中,悄悄补上让VR体验更接近"科幻电影"的细节。对于习惯了手势追踪的用户而言,这次更新最大的意义在于"去手柄化"的进一步实现,你可以完全扔掉控制器,仅凭双手在虚拟空间中自由行走、整理应用。交互进化:裸手导航虚拟空间长期以来,手势追踪多用于简单的点选和滑动,一旦涉及移动,用户不得不重新拾起手柄。HorizonOS2.4改变了这一现状。在虚拟家庭空间(HorizonHome)中,用户只需握拳并按下大拇指,即可唤出隐形控制面板。通过简单的左右滑动实现转身,或通过射线指向目标区域进行"瞬移"(Teleport)。这一机制极大地提升了碎片化使用的体验:当你只是想戴上头显看看Instagram动态、浏览网页或欣赏环境风景时,不再需要寻找手柄。值得注意的是,系统的视觉反馈设计相当成熟。当手势移动激活时,手部会显示方向指示器,而在非操作状态下,UI完全消失,保证了视野的纯净度。应用管理:从"算法排序"回归"我的地盘"如果说手势移动是锦上添花,那么自定义应用库则是一次迟到的刚需升级。过去,Quest的应用库强制遵循"最近使用"、"字母排序"或"安装时间"等自动化逻辑,导致那些需要长时间通关的3A大作(如《阿斯加德之怒2》)极易被淹没在信息流中。用户被迫像翻阅通讯录一样去寻找游戏,这显然不符合"客厅娱乐"的直觉。HorizonOS2.4引入了清除排序模式。关闭自动排序后,用户可以像在智能手机桌面上一样,随意拖拽应用图标,或将它们堆叠成文件夹。这种"我的地盘我做主"的自由度,显著降低了从开机到进入游戏的路径成本。将常用系统工具置顶,把正在进行的游戏放在触手可及的位置,这才是高效的空间计算逻辑。必须先清除自动排序,才能拖动Quest游戏和应用。PTC2.4更新后,可以将游戏和应用拖放到Quest库中的任何位置。除了显性功能的增加,2.4版本还包含了一项针对"空间计算"场景的底层优化--应用崩溃恢复。在以往的系统中,如果浏览器意外闪退,所有打开的多窗口布局都会闪退。新版本应用在异常关闭后可以尝试恢复到之前的会话状态。虽然这项功能有待验证,但它释放了一个明确信号:Meta正在让Quest3承担起比VR游戏更复杂的任务,比如作为多屏办公终端,而稳定性一切的基础。