在2025年3月举行的GDC(游戏开发者大会)上,题为“融合现实,倍增奇迹:混合现实开发专家指导”的会议吸引了广泛关注。来自Meta、Resolution Games、Niantic等公司的专家分享了最新的MR(混合现实)开发见解和技术进展。以下是会议的精华内容。

Meta 产品经理 Kirk Barker 首先介绍了混合现实的基本概念和关键组件。他以《Guardian of Realms》这款混合现实游戏为例,描述了虚拟入侵者如何进入用户的客厅,并展示了如何在现实环境中进行互动战斗。

主要技术要点:

透视与深度感应:头戴式设备上的摄像头捕捉现实世界的图像,并使用深度API检测物体的距离,实现虚拟和物理物体之间的自然遮挡。

锚点:在3D坐标空间中设定参考点,确保虚拟物体固定在同一位置。例如,将海报贴在墙上后,它会始终保持在该位置。

场景理解:识别房间结构和家具的技术,为开发者提供语义信息(如墙壁、天花板、沙发、床),从而创建与现实世界空间相对应的游戏体验。

Barker 强调,通过结合这些元素,可以创造出引人入胜、具有沉浸感和互动性的混合现实体验。

Creature 工作室创意总监 Doug North Cook 分享了开发 Meta Quest 混合现实游戏《Starship Home》的经验:

关键设计原则:

表面感知:设计能够适应任何表面的虚拟物体。例如,花盆可以根据环境变化调整其外观和行为。

产品设计思维:虚拟物体需要像真实物体一样细致且具有交互性。目标是让用户愿意移动真实的家具来容纳虚拟物体。

让不可能成为可能:创造看似不存在但感觉存在的元素。例如,储物格延伸到地板以下15英尺,给用户带来逼真的体验。

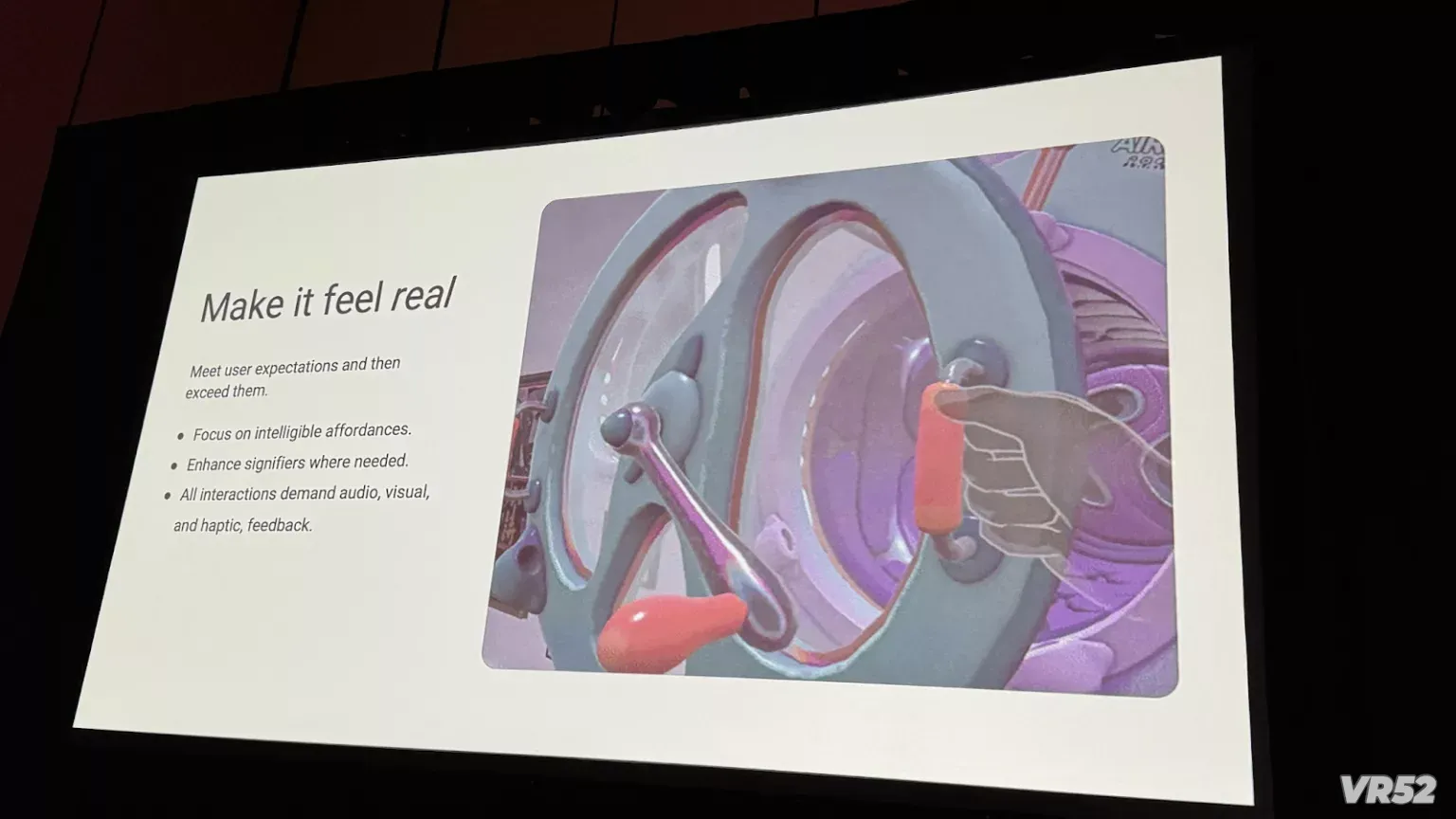

直观的操作:确保用户能通过观察了解物体的功能,并在必要时使用标签或其他标志。

互动深度:每个操作都融入声音和动作反馈,增强物理力学的感觉。团队称之为“Goopy”元素,这是取悦和惊喜用户的关键。

Cook 强调,“混合现实的神奇之处在于它可以在任何空间创造新的记忆”。他鼓励开发者将房间本身视为一个角色,并在任何环境中提供有意义的体验。

Kirk Barker 接着介绍了3月份发布的全新透视摄像头 API。该 API 允许开发者访问耳机的前置摄像头,捕获现实世界的图像并在应用程序中使用它们。

主要用例:

对象检测:结合机器学习框架(如 YOLO 算法),识别现实世界的物体并显示边界框和概率。

纹理映射:将现实世界的纹理应用到虚拟物体上,使虚拟物体更好地融入环境。

滤镜应用:调整现实世界的亮度和颜色,增强视觉效果。

Barker 展示了一个使用 YOLO 算法的示例,该算法从 Hugging Face 下载,编译到 Unity 中,并与透传 API 结合,展示了如何识别现实世界的物体并显示相关信息。

Resolution Games 首席执行官 Tommy Palm 分享了三个利用透视摄像头 API 的游戏案例:

Spatial Ops:一种新型射击游戏,玩家可以利用家里的空间与远方的玩家进行多人游戏。虚拟障碍物逐渐与房间融为一体,增加了沉浸感。

实验室老鼠:异步多人游戏体验,其中一个玩家的房间通过透视摄像头进行3D扫描,另一个玩家以鼠标形式进入该空间解决谜题。

Twenty Guys:玩家通过混合现实头戴设备观看2D图像创建玩偶纹理,生成角色并进行独特游戏体验。

Palm 强调,这些游戏不仅展示了技术的强大功能,还突显了混合现实在减少晕动症方面的优势。

Niantic 执行制片人 Alicia Berry 讲解了将手机 AR 游戏 Peridot 移植到 Quest 3 的过程,即《Hello Dot》。她介绍了几个关键技术应用:

Dot 摄像头:跟踪 Dot 的摄像机模式,使用 Niantic 的 3D 扫描应用 Scaniverse 对房间进行扫描,然后将其渲染为高斯图。

物体检测:使用 Niantic 专有的 ARDK(增强现实开发套件)检测现实世界中的物体。例如,Dot 发现一棵树并感到兴奋。

Berry 还展示了“路线指引”的使用案例,通过高斯斑进行空间导航,引导用户在现实世界中移动。

通过这次会议,开发者们深入了解了 MR 技术的进步和应用场景。Meta 的新透视摄像头 API 为开发者提供了更多工具,使得混合现实体验更加丰富和沉浸。无论是通过表面感知、产品设计思维还是直观操作,开发者都能创造出令人惊叹的混合现实体验。未来,随着技术的不断进步,混合现实将在更多的领域中发挥重要作用。

VR52网成立于2015年,平台提供VR头显、AR眼镜、配件外设、厂商、测评、行业资讯、游戏与应用、展会活动等。